CVPR 2018 | 商湯科技論文詳解:FaceID-GAN:基于三方博弈和信息對稱的可控人臉生成

下周CVPR 2018大會將開啟,以下是商湯科技在深度生成對抗式模型方向,提出的基于三方博弈和信息對稱的可控人臉生成算法。

論文:FaceID-GAN: Learning aSymmetry Three-Player GAN for Identity-Preserving Face Synthesis

作者:Yujun Shen, Ping Luo, Junjie Yan, Xiaogang Wang, Xiaoou Tang

論文鏈接:http://openaccess.thecvf.com/content_cvpr_2018/papers/Shen_FaceID-GAN_Learning_a_CVPR_2018_paper.pdf

FaceID-GAN生成效果展示:

簡介

近年來,生成式對抗網絡(GAN)的提出和發展使得生成式模型(generative model)有了飛速的進步。然而,如何對生成過程進行有效操控(如使用條件生成式對抗模型conditional GAN),仍有很大的探索空間。本研究以人臉生成為例,提出FaceID-GAN,它是一種可以保持身份信息不變,對人臉姿態和表情進行控制的生成式模型,大大提高了生成式對抗網絡(GAN)的可操控性。區別于傳統GAN所解決的雙方博弈問題,FaceID-GAN的主要設計思想基于“三方博弈”(3-player game)和“信息對稱”(information symmetry)。大量的實驗結果表明,該方法可以很好地在身份、姿態、表情方面對人臉生成過程進行控制。同時,該模型的設計理念可以輕松地應用于其他有條件的生成式問題上。

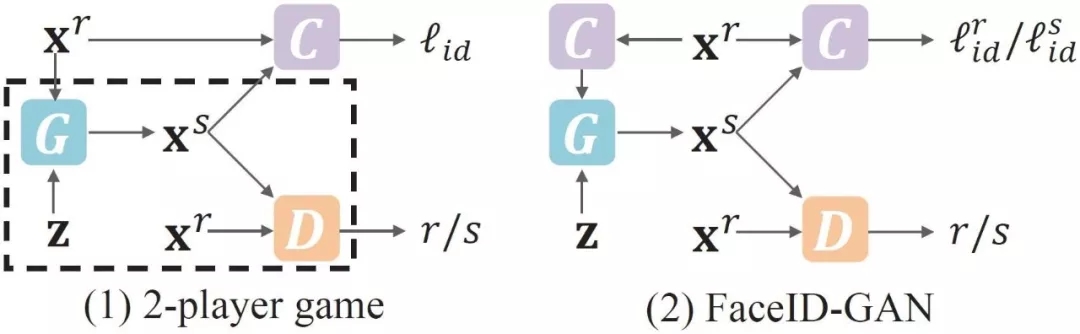

生成式模型是機器學習的重要分支之一,其目標是從真實數據中學習數據服從的分布,然后根據學習到的分布進行采樣,生成足夠真實的數據。對抗生成網絡(GAN)是目前最有效的生成式模型之一(如圖1(左)中虛線部分所示),它包含兩個部分:一是判別器Discriminator,用來區分真實數據Xr的分布和生成數據Xs的分布;二是生成器Generator,利用隨機噪聲Z作為輸入生成數據Xs,其目的是學習到真實數據的分布,使得生成數據Xs足以迷惑判別器D。兩者進行博弈,當達到平衡點的時候,判別器D已經無法區分真實數據分布與生成數據分布,可以認為生成數據已經足夠真實。

圖1:本文提出的FaceID-GAN和傳統GAN的比較

當對生成過程增加限制條件時,比如控制生成人臉的身份信息和輸入的人臉相同,如圖1(左)所示,常見做法是增加一個圖像分類器Classifier。分類器C的目標是對人臉的身份信息進行分類,這里既包括對真實圖片Xr進行分類(確保C提取的是身份信息而不是其他信息),同時包括對生成圖片Xs進行分類(起到監督控制Xs身份的作用)。此時生成器G不僅要滿足生成圖片Xs可以迷惑判別器D,同時還要滿足生成圖片Xs被分類器C分到與相應的輸入圖片Xr相同的類別。

然而,此類方法對于身份信息的保持程度并不高,本文作者認為原因有以下兩點。第一,分類器C在這一框架中并沒有參與到生成器G與判別器D的博弈當中,僅僅起到了為生成數據Xs提供身份監督的作用,約束條件不夠強。第二,從圖1(左)中可以看出,對于生成器G來說,身份信息的監督是由分類器C提供的;而身份信息的輸入則直接來源于Xr。這不僅增加了生成器G的學習難度(學習數據分布的同時,還要學習提取身份信息),而且整個網絡中存在對身份信息的兩套編碼(分別來自生成器G和分類器C),兩者的不統一大大增加了網絡的收斂難度。

基于三方博弈和信息對稱的可控人臉圖像生成

為此,本文所提出的FaceID-GAN進行了以下改進(如圖1(右)所示)。第一,將原有的“雙方博弈,一方監督”擴展為“三方博弈”。即分類器C在對真實圖片Xr的身份信息進行分類的同時,還要對真實圖片Xr和生成圖片Xs的身份信息進行不同的分類。具體來說:假設真實圖Xr中有N個身份,那么分類器C要進行2N分類。其中,將Xr的不同身份分到前N類,將相應生成的Xs的不同身份分到后N類(即真假不同分類)。與此同時,生成器G在身份信息方面與分類器C進行博弈。類比生成器G和判別器D之間的博弈,分類器C試圖從身份信息方面將真實圖Xr和生成圖Xs區分開,而生成器G試圖迷惑分類器C。這樣設計的好處在于,在訓練過程中,分類器C從真假圖片的身份信息上施加約束條件,而這一約束條件隨著生成器G生成圖片身份相似度的提高而不斷加強,反過來促使生成器G生成身份信息保持度更高的圖片。

第二,提出了基于信息對稱的模型框架。即生成器G不再直接以真實圖片Xr作為輸入,取而代之的是由分類器C從Xr中提取得到的身份信息。這樣改進的好處在于,生成器G無須重新學習身份信息,整個網絡中只存在身份信息的一套編碼(來自分類器C)。同時,對生成器G來說,身份信息的輸入和監督都由分類器C提供,統一了評價標準,使得網絡更容易收斂。

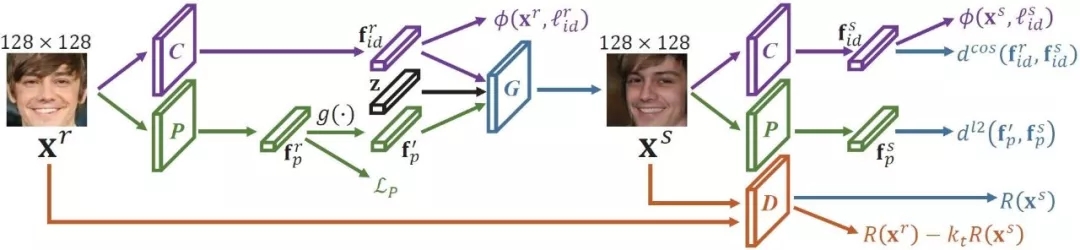

第三,為了進一步控制生成人臉的姿態和表情,本方法利用3DMM模型對人臉進行建模,并加入到FaceID-GAN的訓練框架中。3DMM是一種能夠將二維人臉投射到三維空間的模型,其參數主要包括形狀(shape)、表情(expression)和姿態(包括放縮、平移和旋轉,本文主要考慮旋轉)。同身份信息一樣,姿態和表情是人臉的額外信息。如圖2所示,本文作者在框架中增加參數提取器P對真實圖片Xr進行此類信息的提取,同時利用參數提取器P對生成圖片Xs進行姿態表情的監督。與分類器C所不同的是,Xs和Xr需要在身份信息上保持不變,而在姿態和表情方面可以控制(可變),因此參數提取器P并不與生成器G進行博弈,僅僅起到監督的作用,但依然使用“信息對稱”的設計思想。

圖2:

FaceID-GAN的訓練框架

具體訓練框架如圖2所示,給定一張輸入真實圖像Xr,通過分類器C提取出身份信息,通過參數提取器P提取出姿態表情信息(即3DMM參數),然后利用函數g(·)對參數中的姿態和表情部分進行修改(由于3DMM參數中的形狀部分與身份相關,因此不做修改),得到目標信息(即為控制生成相應的姿態表情所對應的參數)。生成器G以身份信息、目標姿態表情信息和噪聲z為輸入,輸出生成圖像Xs。生成圖像Xs利用同樣的分類器C和參數提取器P進行監督(前后兩個C和兩個P均共享參數),以保證身份的保持,以及姿態表情的可控。與此同時,生成器G和判別器D在圖像真實性上進行對抗,生成器G和分類器C在身份信息上進行對抗,實現三方博弈。(注:圖2中的?(·,·),dcos(·,·),dl2(·,·),R(·)代表不同的損失函數)。

實驗結果

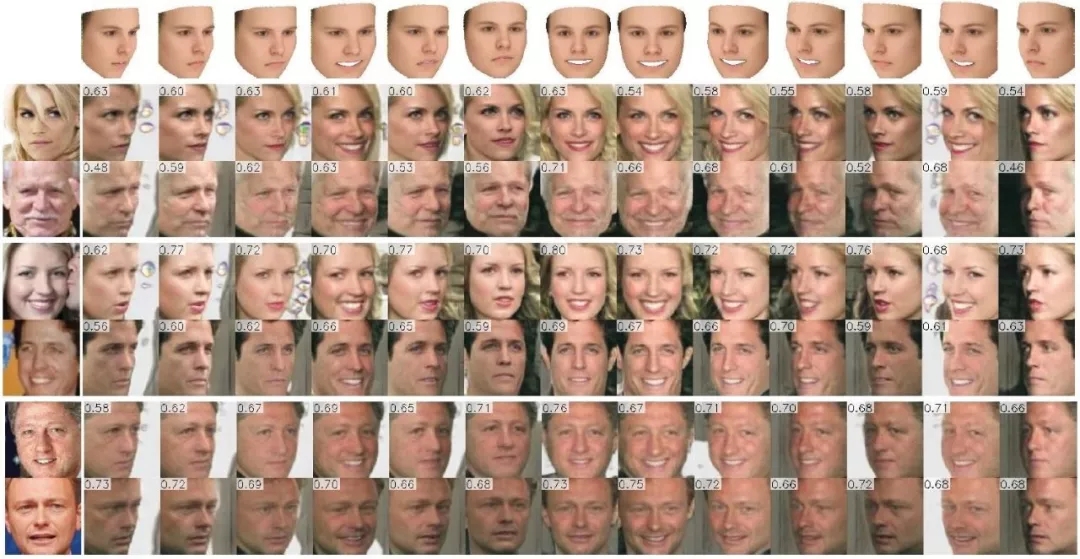

圖3和圖4展示了FaceID-GAN模型的人臉生成結果。由圖3中可以看出,FaceID-GAN所實現的高質量人臉生成,在很好地保持輸入圖片的身份信息的同時,可以生成連續變化的姿態和表情。圖4中的第一行展示了目標3DMM參數所對應的三維人臉模型,第一列為輸入圖片。從行列的交叉比較中可以看出,FaceID-GAN能夠將身份信息和姿態表情信息剝離開來,魯棒地實現身份的保持和姿態表情的可控。

圖3:

FaceID-GAN生成結果,左上角為輸入圖片,

前兩行為不同給定姿態條件下的生成圖像,

第三行為不同給定表情條件下的生成圖像

結論

本文作者認為,此框架不僅適用于人臉生成,還可以用于設計解決其他有條件的生成模型。其遵循的原則為:真實圖像和生成圖像采用相同的評價標準,保持信息的前后對稱。同時,信息中需要保持不變的部分(如身份信息、圖像真實性)進行對抗博弈,需要控制改變的部分(如姿態、表情)不進行對抗。在FaceID-GAN中具體表現為,生成器G的信息輸入和信息監督都是通過分類器C和參數提取器P得到的,體現了信息對稱原則。同時,為了保證生成圖像真實性與輸入圖像相同,生成器G與判別器D進行對抗;為了保證生成圖像身份信息與輸入圖像相同,生成器G與分類器C進行對抗;為了控制改變生成圖像的姿態和表情,生成器G與參數提取器P不進行對抗。沿著這一思路,三方博弈可以擴展至多方博弈,解決更加復雜的生成問題。

返回

返回

人工智能基礎設施

人工智能基礎設施 企業服務智能化

企業服務智能化 城市管理智能化

城市管理智能化 汽車出行智能化

汽車出行智能化 個人生活智能化

個人生活智能化