CVPR 2021 Oral|商湯提出最新深偽評測基準 ForgeryNet:左右互搏——論火眼金睛的修煉

在 CVPR 2021 上,商湯通用智能通用視覺團隊針對現有的人臉深度偽造技術發展對社會安全方面造成了威脅的現象,構建了一個目前維度最大最豐富的公開數據集和評測基準。在數據規模方面,ForgeryNet 包含了 290 萬張圖像和 221,247 個視頻,15 個人臉深度偽造操作(其中包括7個圖像層面的偽造方法,8 個視頻層面的偽造方法),加入了多種擾動(36 種以上的擾動)以模擬真實世界中遇到的挑戰,并包含豐富數據標注以供研究者進行探索(其中包含 630 萬個分類標簽,290 萬個偽造空間定位標注和 221,247 個時序偽造標注);在評測方法上,提出了四種不同的圖片級和視頻級評測方法。我們希望 ForgeryNet豐富的數據、標簽、質量和多樣性能夠促進人臉偽造分析等領域的進一步研究和創新。

這項研究由商湯通用智能通用視覺團隊、北京郵電大學、北京航空航天大學、中國科學技術大學、南洋理工大學共同完成。

論文名稱:

ForgeryNet: A Versatile Benchmark for Comprehensive Forgery Analysis

Part 1 問題和挑戰

逼真的人臉深度偽造技術,尤其是最近的深度學習的 DeepFake 技術引起了廣泛的社會關注,人們擔心這些技術可能被惡意濫用以欺騙性地偽造人臉。開發用于面部偽造分析的可靠方法,以區分圖像和視頻是否被操縱以及在何處被操縱是計算機視覺中一個重要方向。近年來人臉偽造的數據集已經被提出很多,但是,現有的數據集依然存在有局限性:

1. 數據缺乏:目前的數據集最多包含 10 萬個偽造視頻或 24 萬張偽造圖片。ForgeryNet 提供了至少 12 萬個偽造視頻和上百萬的偽造圖片。

2. 多樣性缺乏:目前的數據集最多只用了 8 種面部篡改方式和 19 種后處理擾動。ForgeryNet 從人臉位姿、表情、光照、場景、人臉大小等多個維度,收集了不同相機采集、不同分辨率的未受控原始數據,使用了 15 種不同的方法對面部進行修改,并將 36 種后處理擾動方式的多種組合應用于生成的視頻/圖片上。

3. 性能飽和:目前很基礎的深度學習模型,就可以在當前數據集上達到非常好的結果。這是因為現有的數據集場景較為簡單,和真實的場景有差距。

4. 數據標注和任務多樣性缺乏:現有的數據集往往只關注于視頻/圖片是否被操縱的二分類結果中,較少提供其他的標注信息。在這個數據集中,我們不僅提供了真實和偽造的 2 分類標簽,還提供了具體偽造的方法、偽造的空間位置的掩碼和時間拼接的標簽信息。同時,為了豐富偽造分析的維度,我們還提出了四個偽造分析的任務,分別是圖片分類、視頻分類、空間定位和時間定位。

Part 2 數據集豐富的數據和標注

我們從四個數據集中收集角度、表情、身份、照明、場景等各種維度的原始數據。ForgeryNet 包含了 290 萬張圖像和 221,247 個視頻,15 個人臉深度偽造操作(其中包括 7 個圖像層面的偽造方法,8 個視頻層面的偽造方法),擾動(36 種以上的擾動)和數據標注(其中包含 630 萬個分類標簽,290 萬個偽造空間定位標注和 221,247 個時序偽造標注),各種偽造的數據分布,如圖 2 所示。與各種偽造數據集進行比較, ForgeryNet 在規模和多樣性方面均超過任何其他數據集。它提供視頻和圖像兩種數據,偽造數據是通過 2 大類中的 15 種操縱方法構建的,具體的方法將在后面介紹。

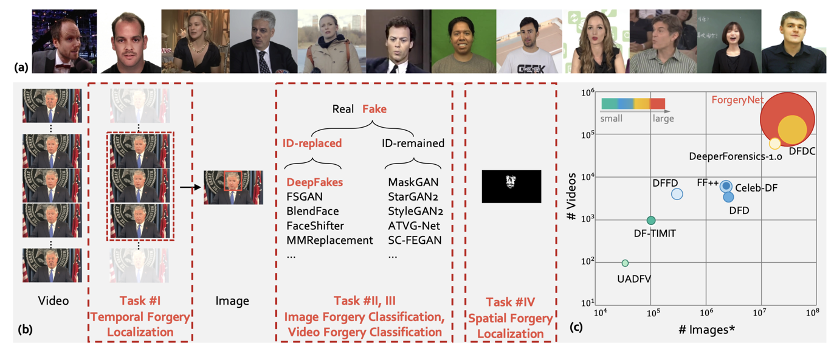

圖 1 與其他基準的對比

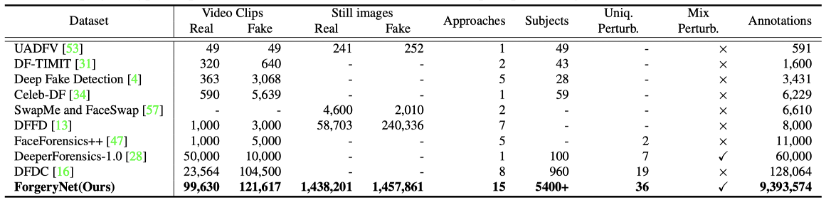

圖 2 視頻及圖片偽造數據分布圖

Part 3 偽造方法介紹

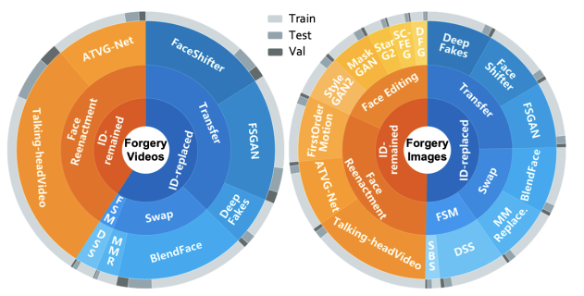

圖 3 偽造方法分類

3.1 身份信息保留的偽造方式

圖 3(a)中的身份保留偽造方法保留了![]() 的身份,并且以

的身份,并且以![]() 的對應屬性驅動改變了

的對應屬性驅動改變了![]() 的表情、嘴、頭發和姿勢等與身份無關的內容。我們采用八種偽造方法,將其分為兩個子類型:

的表情、嘴、頭發和姿勢等與身份無關的內容。我們采用八種偽造方法,將其分為兩個子類型:

1)通過面部動作重現的操縱方式,![]() (i,a)保留了其身份,但是其固有屬性如姿勢、嘴巴動作和表情受到了屬性源

(i,a)保留了其身份,但是其固有屬性如姿勢、嘴巴動作和表情受到了屬性源![]() 的操縱并形成了

的操縱并形成了![]() 操縱,其中指a表示屬性。

操縱,其中指a表示屬性。

2)通過面部編輯的操縱方式,![]() (i,a)的外部屬性發生了變化,例如面部毛發、年齡、性別和種族,以獲得

(i,a)的外部屬性發生了變化,例如面部毛發、年齡、性別和種族,以獲得![]() 。

。

3.2 身份信息修改的偽造方式

圖3(b)中的身份變化的偽造方法將的身份信息替換為![]() 的身份信息。我們采用了7種偽造方法,共分為三種類型:

的身份信息。我們采用了7種偽造方法,共分為三種類型:

1)人臉遷移![]() 將身份有關的內容和身份無關的內容(例如表情和姿態)都從

將身份有關的內容和身份無關的內容(例如表情和姿態)都從![]() 轉移到

轉移到![]() 。

。

2)身份交換![]() 僅將s身份從源

僅將s身份從源![]() 交換到目標

交換到目標![]() ,這意味著身份無關的內容由

,這意味著身份無關的內容由![]() 保留。

保留。

3)人臉堆棧操縱指的是連續對視頻/圖片進行保留身份和修改身份的操縱行為。

Part 4 偽造的流程

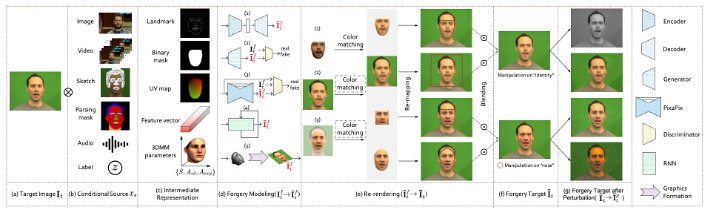

我們分別從換臉、面部編輯、動作重現的三個類別共 15 種方法對收集的數據進行面部偽造,整個生成的步驟如圖 4 所示。

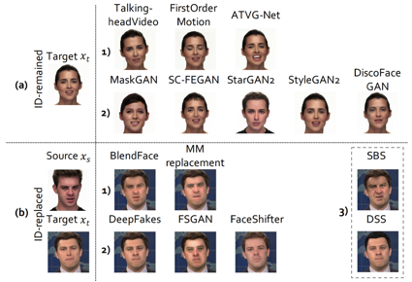

圖 4 圖像操縱示意圖

(a)~(c) ,目標圖像始終由![]() 表示,而面部偽造的驅動源-

表示,而面部偽造的驅動源-![]() 則有多種條件的格式,如圖像、圖像序列、草圖、人臉五官解析的掩碼、音頻、標簽,甚至是噪聲。我們首先在這一步中對

則有多種條件的格式,如圖像、圖像序列、草圖、人臉五官解析的掩碼、音頻、標簽,甚至是噪聲。我們首先在這一步中對![]() 進行裁剪和對齊目標人臉,然后將目標人臉和源數據轉換為中間表示形式,例如 UV 貼圖、特征向量、3DMM 參數等。

進行裁剪和對齊目標人臉,然后將目標人臉和源數據轉換為中間表示形式,例如 UV 貼圖、特征向量、3DMM 參數等。

(d) 通過 15 種不同的面部偽造方法(它們分別基于編碼器-解碼器結構、對抗生成網絡結構、循環神經網絡結構等)對處理過的臉圖![]() 進行偽造臉圖

進行偽造臉圖![]() 生成。

生成。

(e-f) 為了獲得完整的偽造目標圖像,將偽造目標人臉![]() 重新渲染回目標完整圖像

重新渲染回目標完整圖像![]() ,以獲得

,以獲得![]() 。特別地,1)

。特別地,1) ![]() 可以是如圖 4 (e-1) 所示的面部,其中包含從眉毛到下巴的區域。2)

可以是如圖 4 (e-1) 所示的面部,其中包含從眉毛到下巴的區域。2) ![]() 也可以是一個面部邊界框,如圖 4 (e-2,3) 所示,根據不同的偽造程序,該邊界框與原始目標面部保持相同的邊界框。

也可以是一個面部邊界框,如圖 4 (e-2,3) 所示,根據不同的偽造程序,該邊界框與原始目標面部保持相同的邊界框。

(g) 為了更好地反映現實世界中的數據分布,我們對偽造數據![]() 施加了包括 36 種類型的攝動擾動。我們遵循圖像和視頻質量評估中的常規做法,模擬了壓縮、傳輸、捕獲、色彩會失真,同時還提供了組合兩種以上擾動的多重擾動。

施加了包括 36 種類型的攝動擾動。我們遵循圖像和視頻質量評估中的常規做法,模擬了壓縮、傳輸、捕獲、色彩會失真,同時還提供了組合兩種以上擾動的多重擾動。

Part 5 評測標準

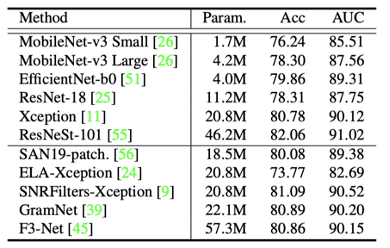

5.1 偽造圖片分類

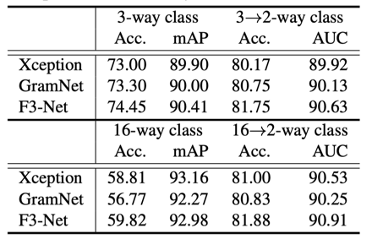

在給定偽造圖像的情況下,我們提供了三種類型的偽造標簽,即用于 2 分類(真實/偽造),3 分類(真實,使用身份替換偽造方法,使用偽造且保留身份的偽造方法)和 n 分類(n = 16,真實和 15 種偽造方法)分類任務。這些標簽使探索不同的偽造類型或方法之間的相關性成為可能。

在圖片分類任務中,我們提出了兩個評測方案:

方案1:偽造方法內部評估。在偽造方法內部評估中,訓練集中的所有真實數據和偽數據都用于訓練模型,而驗證集用于評估。在 ForgeryNet 中根據我們提供的標注,可以完成偽造的 2 分類(真 / 假)、3 分類(真 / 身份信息保留的偽造方式 / f身份信息修改的偽造方式)、n 分類(n = 16, 真和 15 種偽造方法)。

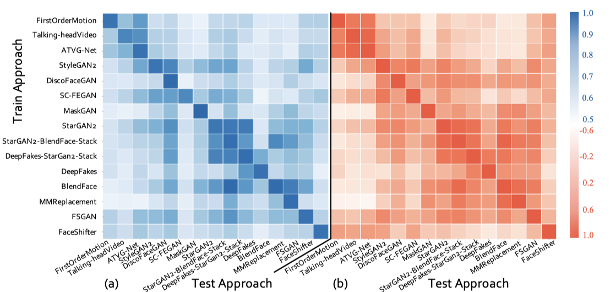

方案2:交叉偽造方法評估。為了進一步利用我們的數據評估訓練的泛化能力,我們通過使用一種特定類型的操作訓練評估的取證方法并與其他類型的測試進行交叉偽造評估。偽造類型可以是某種偽造方法大類(例如,替換身份),也可以是特定的方法(例如,ATVG-Net)。

我們測試了多種算法基線,Acc 分數顯示,隨著類別數量的增加,分類變得更加困難,而 mAP 指標表明,判別能力反而變得更高。這表明更多的輔助信息可能使取證模型更具區分性。

圖 5 偽造圖片分類分析方法評估結果

圖 6 交叉偽造方法評估性能表

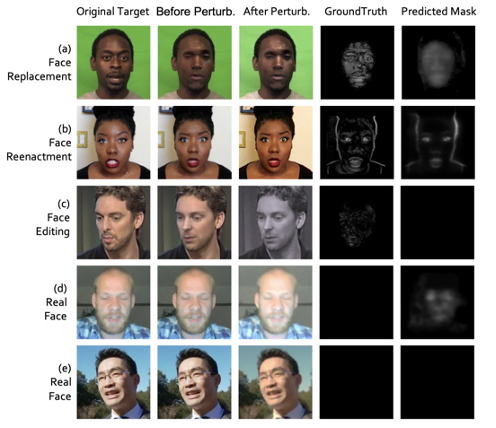

5.2 偽造空間定位

與分類任務相比,空間偽造定位旨在指定偽造區域。在 ForgeryNet 中提供了圖像及其偽造部分的掩碼圖用于訓練空間定位模型。

我們在偽造空間定位中評估了直接回歸和其他兩種分割方法的性能。在圖7(c)中,很難檢測到輕微的胡須變化,而在圖 7(d)中,實際圖像在操作時被誤判。

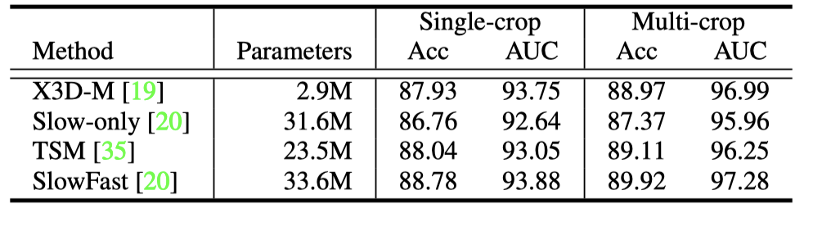

5.3 偽造視頻分類

同偽造圖像分類一樣,我們提供了偽造方法的大類和方法標簽。在 ForgeryNet 中根據我們提供的標注,可以完成偽造的 2/3/n 分類和跨偽造方法的泛化性測試。

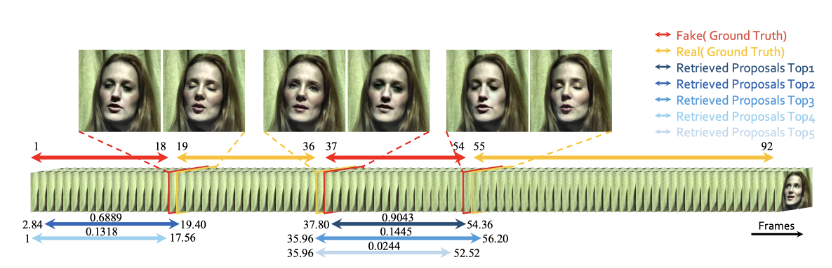

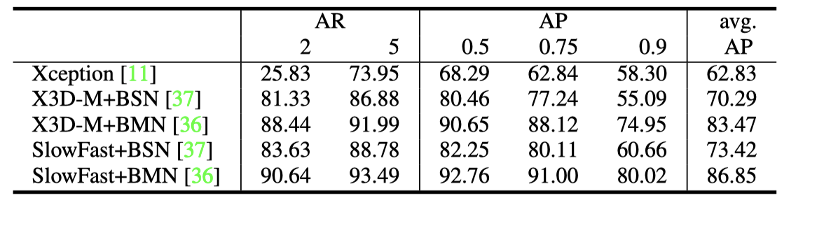

5.4 偽造時序定位

圖 8 偽造時序定位分析

對于每個視頻,要評估的取證方法都有望提供偽造片段的時間邊界和相應的置信度值。目標是生成高質量建議,這些建議涵蓋具有高時間重疊和召回的操縱段,我們使用主流的 BSN 和 BMN 方法對偽造的時序片段進行定位,其性能指標如圖8和表所示。

Part 6 結語

本文提出了一個更加全面的深度偽造分析基準 ForgeryNet,為圖像和視頻水平的人臉偽造分析。與現有的人臉偽造數據集相比,ForgeryNet 數據來源廣泛、偽造方法和質量多樣、注釋豐富,能夠促進人臉偽造分析等領域的進一步研究和創新。對于未來的工作,我們歡迎有興趣的研究人員貢獻更多新穎的面部偽造方法,或對數據集進行更多的偽造分析,以促進深度偽造領域的發展。

論文鏈接

https://arxiv.org/abs/2103.05630

Project

返回

返回

人工智能基礎設施

人工智能基礎設施 企業服務智能化

企業服務智能化 城市管理智能化

城市管理智能化 汽車出行智能化

汽車出行智能化 個人生活智能化

個人生活智能化