商湯提出基于空間修剪的NAS算法

導讀:在CVPR 2020上,商湯AutoML團隊提出的首個基于參數后驗分布特性來提高網絡機構搜索性能的工作,該工作為解決網絡機構搜索中快速代理的有效性問題提供了新的思路。同時該團隊也公開了在ImageNet數據集上的兩種不同尺寸的模型,作為模型結構搜索和設計的baseline。相比之前的工作,PC-NAS在結構搜索代理的有效性上有明顯的提升。

動機

該文章提供了一個分析One-shot參數后驗分布的方式,在得出搜索空間中存在的結構越多參數后驗分布偏離得越多的結論后,提出了一個基于空間修剪的NAS算法。該工作的研究動機在于:

1. 當前網絡結構搜索算法(NAS)已經可以應用應用。其大量的計算量需求成為了當前最大的問題。然而解決計算量問題的方法目前還不完美,使用共享參數的超網做代理成為了目前比較普遍的選擇。但這類方法受限于代理和真實情況的偏差。

2. 根據觀察和分析,共享參數在訓練過程中得到的參數后驗與單個模型獨立訓練的參數分布有一定的規律。接下來將詳細介紹該工作的觀察和分析。

根據貝葉斯模型選擇(以及一定的假設),該工作對共享權重對結構排序帶來的影響給出了兩個觀察:

共享權重的參數分布與不共享的retrain時刻的結構參數分布的關系可以用KL散度來衡量。

可供選擇的模型數量上升時,該散度隨著結結構數量增加而增加。

相關細節請參考論文

算法

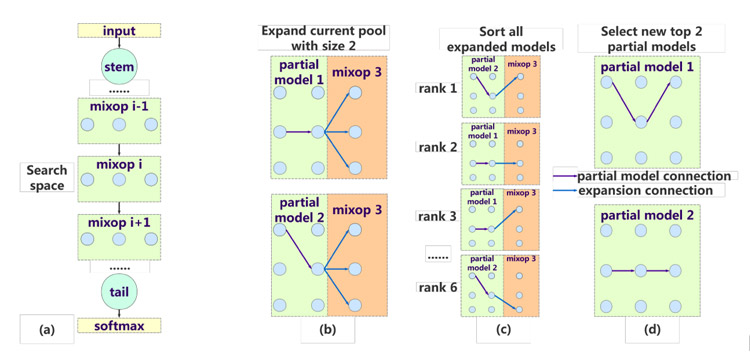

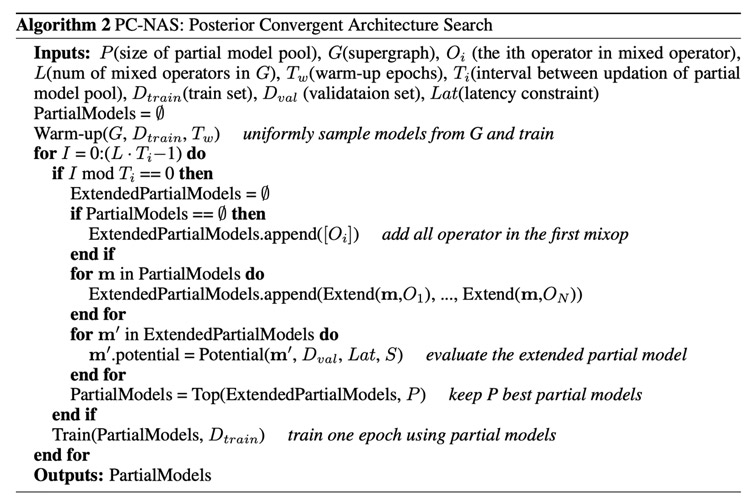

為了在訓練權重共享的同時,減小權重共享的網絡結構數量,我們提出一種訓練時的空間修剪方法。假設我們目前有一個如上圖(a)所示的超網,每一層擁有一個mixop(mixop是n個候選op的合稱)于是該超網中總共包含n^層數個不同的結構。為了進行搜索空間的修剪,我們提出了 部分結構池的概念(partial model pool)。假設網絡結構有L層,部分結構池在整個搜索過程中將會有L個狀態(Stage)。每從L-1狀態到L狀態,部分結構池中的子結構的層數將增長1。

如圖(b),此時Stage=2,在部分結構池中有兩個層數為2的結構,通過節點編號命名為(1,1)和(0,1)。為了進行至Stage=3,我們會評估2x3個部分結構的潛力,分別是(1,1, 0),(1,1,1),(1,1,2),以及(0,1,0),(0,1,1),(0,1,2)。如何評價部分網絡的優劣或者說潛力呢?

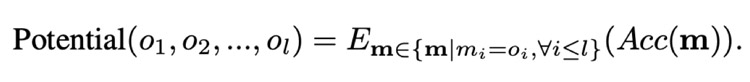

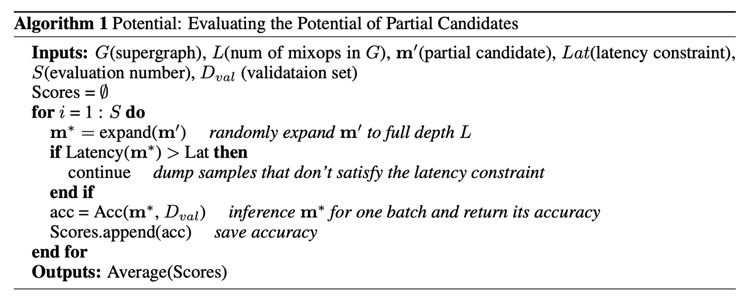

為此我們定義 Potential 是在部分結構中為指定的mixop進行隨機采樣的結構的平均validation set acc。

為此我們定義 Potential 是在部分結構中為指定的mixop進行隨機采樣的結構的平均validation set acc。

搜索結果

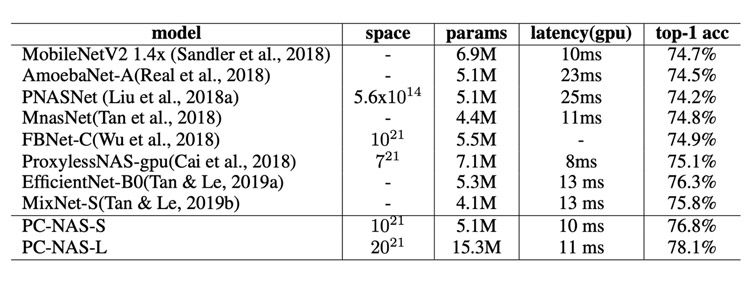

更具上上述搜索過程我們分別在一大一小兩個網絡空間中進行搜索。小搜索空間中每層包含9種operator,大搜索空間包含每層19種operator。我們把大搜索空間的搜索結果命名為PC-NAS-L,小搜索空間的模型命名為PC-NAS-S。

上表可以看出,在同等的gpu lantency下,我們的PC-NAS可以超過或不低于所有baseline。

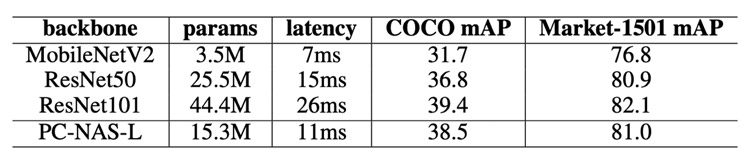

在檢測任務中可以看驗證模型的魯棒性。

代理保序性

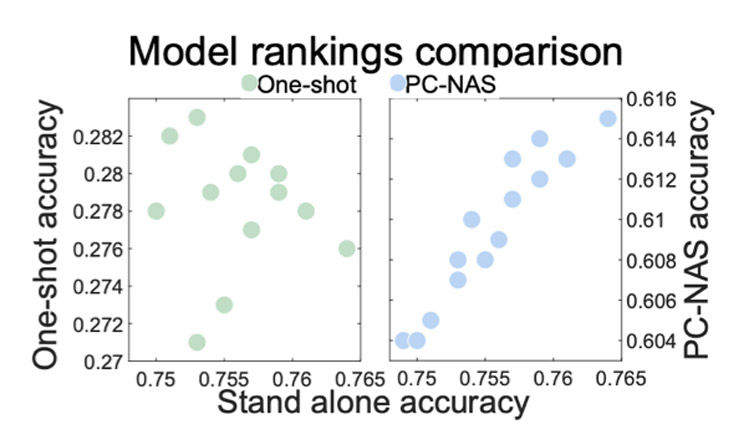

那么我們采用的搜索空間收縮算法是否有效的提高了代理的有效性呢?

我們將同一套代碼,使用從頭至尾采用one-shot方法訓練和使用我們的算法訓練的shareweights進行了比較。對于最后存在在最后一個stage中的部分結構模型所拓展的結構,還有我們隨機在one-shot方法中采的相同數量的結構,這兩個群體之間,真實acc和proxyacc之間的相關性。我們可以看到,在最后階段,相關性比one-shot方法要有一定優勢。

傳送門

論文地址:http://xxx.itp.ac.cn/pdf/1910.02543v1

References

[1] Georege Adam and Jonathan Lorraine. Understanding neural architecture search techniques. arXiv preprint arXiv:1904.00438, 2019.

[2] Bowen Baker, Otkrist Gupta, Nikhil Naik, and Ramesh Raskar. Designing neural network architectures using reinforcement learning. International Conference on Learning Representations, 2017a.

[3] Gabriel Bender, Pieter-Jan Kindermans, Barret Zoph, Vijay Vasudevan, and Quoc V. Le. Understanding and simplifying one-shot architecture search. ICML, 2018.

返回

返回

人工智能基礎設施

人工智能基礎設施 企業服務智能化

企業服務智能化 城市管理智能化

城市管理智能化 汽車出行智能化

汽車出行智能化 個人生活智能化

個人生活智能化